¿Por qué millones de personas buscan ayuda psicológica en la IA?

Por: Daniela Regil y Andrea Zárate

La terapia con inteligencia artificial (IA) se ha convertido en uno de los medios más comunes para tratar la salud mental por temas de accesibilidad, inmediatez, vulnerabilidad controlada y practicidad. Por medio de servicios de chatbot como Character.ai, Sintelly, Cux y hasta ChatGPT, personas entre los 16 y los 30 años han encontrado un espacio en donde pueden analizar sus emociones y pensamientos con un solo clic.

De acuerdo con un reporte de la BBC, en la plataforma Character.ai, en donde se puede entablar conversaciones con perfiles personalizados, el personaje “Psicólogo”, desarrollado por un usuario de la plataforma, ha recibido 78 millones de mensajes desde su creación en 2023. Además, dentro de la aplicación existen aproximadamente otros 475 robots que tienen incluidos en sus nombres términos como “terapia”, “terapeuta”, “psiquiatra” o “psicólogo”.

Y aunque diversos especialistas de la salud han manifestado en múltiples ocasiones su desacuerdo con este tipo de prácticas al asegurar que los chatbots no pueden tener la misma efectividad que los terapeutas humanos, los usuarios de este tipo de servicios continúan en crecimiento.

Carlos Rodríguez, psicólogo con especialidad en psicoanálisis, explicó la manera en que la cultura tecnológica persistente en la actualidad influye en este fenómeno.

“Tiene que ver con una cuestión generacional. Es decir, la mayoría de los jóvenes son 100 por ciento nativos digitales, son generaciones que ya nacieron con un uso de esa tecnología prácticamente en su día a día, o sea, del internet, de los dispositivos móviles”, dijo el especialista.

Pero esto no sólo ocurre por un fenómeno generacional. Según la entrevista realizada por la BBC a la profesional en psicología Theresa Plewman, aspectos como la accesibilidad e inmediatez ayudan a que la terapia digital sea tan atractiva para los jóvenes, al permitir que reciban una respuesta eficiente y a cualquier hora del día. Además, el no tener la obligación de llevar a cabo una interacción cara a cara en este tipo de espacios ayuda a que los usuarios se sientan libres de juicio y más cómodos al compartir aspectos íntimos de su vida.

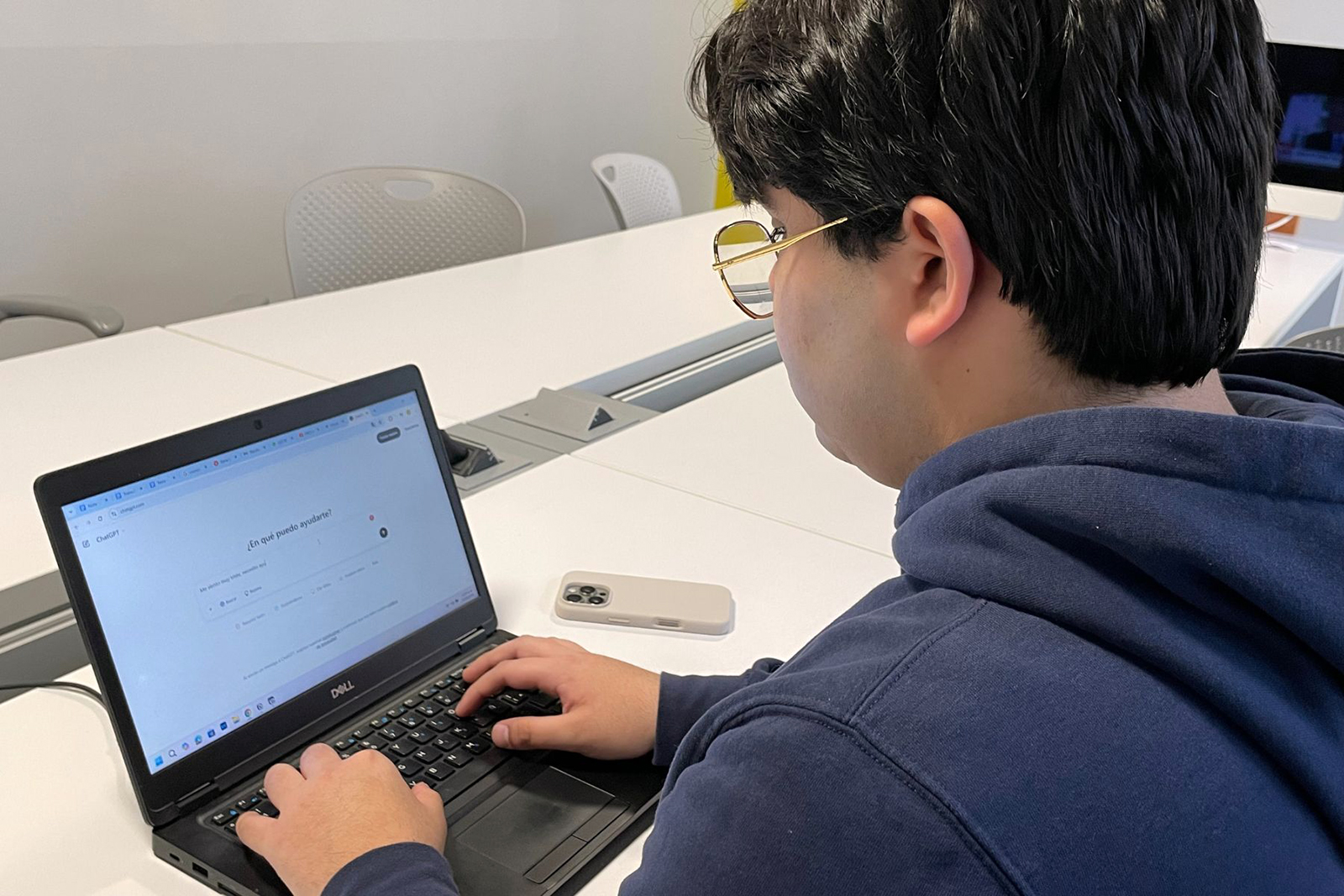

Gael García, estudiante de la Universidad de Monterrey de 20 años, señaló que la razón principal por la que ha acudido a atención psicológica a través de este tipo de plataformas tiene que ver con los altos costos económicos de las consultas.

De acuerdo con un informe de la Secretaría de Salud de México, en promedio, el precio de un especialista en psicología es de 500 pesos por sesión; sin embargo, el costo puede ascender hasta 2 mil pesos. Esto debido a que se toman en cuenta factores como: la localidad, qué tan larga y especializada es la trayectoria del psicólogo y el tipo de terapia que se requiera. Por lo tanto, la falta de recursos económicos se añade como otro factor que lleva a los individuos a utilizar este tipo de herramientas tecnológicas.

La ventaja de la IA, afirmó Carlos Rodríguez, es que es bastante accesible, especialmente para las nuevas generaciones que crecieron con la tecnología. “Al estar estas plataformas programadas para dar siempre una respuesta y tener disponibilidad para cuando se le necesita, consultar algo con un chatbot es muy práctico”.

José Reyna, estudiante de la Universidad de Monterrey de 19 años, contó su experiencia con estos servicios. “Pensé que no era necesario o no era un problema lo suficientemente grande como para ir a atenderlo con un psicólogo. No me estaba causando tanto inconveniente y la inmediatez que te da la inteligencia artificial de nada más preguntarle y te suelta una respuesta es lo que me atrajo. Le da sencillez a tratar el problema que tienes”.

Además, este tipo de plataformas resultan atractivas, puesto que se convierten en una alternativa de ayuda psicológica que evita la estigmatización que aún existe en el país cuando se requieren estos servicios. Datos de la Secretaría de Salud indican que solo dos de cada 10 personas con problemas de salud mental buscan atención especializada y lo hacen en un lapso de entre cuatro y 12 años después de manifestar síntomas.

“Una cosa buena de la inteligencia artificial es que yo podía hablar todo lo que quisiera porque no había un tiempo limitado”, expresó una usuaria de 15 años de Character.ai.

La plataforma Character.ai ha celebrado la conexión y el apoyo que sus personajes ofrecen a los usuarios; sin embargo, también insta a buscar asesoramiento de profesionales certificados en el campo de la psicología para contar con una orientación legítima que les permita desarrollarse favorablemente.

Carlos Rodríguez recalcó la importancia de contactar primero a otro ser humano y después utilizar la IA como una herramienta complementaria de esa terapia.

“De entrada, siempre se tiene que buscar una orientación. Si bien, a lo mejor, hay resistencias para iniciar un proceso terapéutico como tal, es válido el uso de la IA, pero primero se recomienda una consulta o una orientación con un profesional de confianza”, señaló el especialista.

A pesar de la ayuda que les brindó el uso de la inteligencia artificial y las razones por las cuales utilizaron esta herramienta, los testimonios concuerdan en estar conscientes de que buscar ayuda profesional siempre será la mejor opción, ya que la calidez de la interacción humana es algo que no se puede sustituir con un chatbot.

La privacidad y otros riesgos

Cuando se usan este tipo de herramientas tecnológicas, muchas veces es necesario ingresar información personal que resulta sensible a estos modelos, lo que se convierte en un riesgo de que los datos personales puedan ser vulnerados por parte de los servidores con los que trabajan.

“No solo esto, también existe la posibilidad de que la información se vuelva vulnerable directamente desde el dispositivo a través del cual la persona accede”, alertó Rodríguez.

Además, el uso de la IA para atender problemas psicológicos podría resultar peligroso para quienes presentan cuadros emocionales graves.

Bethanie Maples, investigadora de Stanford que estudia los efectos de las aplicaciones de IA en la salud mental, le dijo al New York Times: “No creo que sea intrínsecamente peligrosa. Pero hay pruebas de que es peligrosa para los usuarios deprimidos y crónicamente solos y para las personas que atraviesan cambios, y los adolescentes a menudo los atraviesan”.

Con el objetivo de motivar la participación ciudadana y para garantizar un tratamiento informativo adecuado frente a los contenidos presentados, los invitamos a escribir a agencia2@udem.edu en caso de dudas, aclaraciones, rectificaciones o comentarios.